Не каждая проблема с индексацией связана с контентом или ошибками оптимизации. На крупных проектах поисковый бот нередко расходует ресурс на второстепенные адреса и позже добирается до приоритетных разделов. Из-за этого новые материалы, карточки и посадочные страницы появляются в поиске с задержкой.

Crawl Budget в SEO показывает, как поисковик распределяет внимание внутри ресурса. Чем больше дублей, фильтров, параметров и служебных адресов, тем выше риск, что полезные документы будут проверяться медленнее.

Разберем, когда это становится реальной проблемой и как навести порядок.

Что такое Crawl Budget и почему он важен для SEO

Crawl Budget в SEO — это объем URL, которые поисковая система готова и способна проверить за определенный срок. Чем точнее расходуется этот ресурс, тем быстрее приоритетные документы попадают в обход и индекс.

Как поисковые системы сканируют сайт

Поисковый бот находит адреса через внутренние ссылки, карту сайта, внешние сигналы и уже известные URL. После запроса он оценивает ответ сервера, обнаруживает новые переходы и решает, когда вернуться к документу повторно.

На небольших проектах такой процесс обычно проходит без осложнений. На крупных площадках с тысячами адресов, фильтрами и частыми обновлениями часть ресурса уходит на второстепенные маршруты. В итоге ценные разделы проверяются позже, чем нужно.

Что влияет на бюджет обхода

На бюджет обхода влияют скорость отклика, стабильность хоста, количество адресов и качество структуры. Чем больше на проекте дублей, параметров, страниц поиска и прочих вариаций, тем сложнее поисковику сосредоточиться на действительно нужных документах.

Если архитектура чистая, а технического шума мало, бот быстрее добирается до приоритетных URL. Когда в индексе и в обходе участвует слишком много лишнего, внимание распыляется.

Когда возникает проблема с Crawl Budget

Проблема появляется там, где массив адресов слишком велик, а полезные документы теряются среди служебных и однотипных URL. Чаще всего с этим сталкиваются крупные каталоги, магазины, агрегаторы и контентные платформы с постоянными обновлениями.

Первый тревожный признак — новые страницы долго не попадают в поиск. Второй — изменения на важных URL подхватываются с задержкой. Третий — часть документов остается в статусе «обнаружена, но пока не проиндексирована».

Большие сайты и интернет-магазины

У крупных ресурсов всегда широкий набор маршрутов: карточки, рубрики, пагинация, фильтры, бренды, теги, подборки, поиск по сайту. Когда таких адресов слишком много, обход начинает расходоваться менее точно.

Особенно заметно это в интернет-магазинах и агрегаторах. Там высокий темп обновлений, широкий ассортимент и постоянное появление новых карточек. Если каталог разрастается за счет фильтровых комбинаций и технических URL, свежие позиции и посадочные разделы дольше ждут проверки.

Чем быстрее меняется проект, тем важнее порядок в структуре. Иначе поисковику приходится выбирать между тысячами адресов, среди которых много слабополезных вариантов.

Дубли страниц

Одна из самых частых причин перерасхода — дублирующиеся адреса. Они возникают из-за параметров, сортировок, фильтров, UTM-меток, поиска по сайту и пагинации. Для поисковика каждый такой URL выглядит как отдельная точка входа.

На больших проектах это особенно чувствительно. Фасетная навигация способна создавать огромное количество комбинаций. В результате бот ходит по вариациям, а приоритетные документы получает позже.

Проблема шире, чем классическая ситуация с двумя одинаковыми страницами. Сюда же относятся близкие по смыслу разделы: категории с разной сортировкой, похожие подборки, фильтровые страницы с минимальными отличиями.

Основные факторы, влияющие на краулинговый бюджет

На бюджет обхода сильнее всего влияют три вещи: скорость отклика, объем адресов и внутренняя связность. Чем чище структура и стабильнее работа ресурса, тем выше шанс, что бот сосредоточится на полезных документах.

Скорость ответа сервера

Быстрый и стабильный ответ помогает поисковому боту проверять больше URL за один цикл. Медленный отклик, перебои и ошибки снижают активность.

На обход хуже всего влияют:

- ошибки 5xx;

- код 429;

- долгий ответ сервера;

- нестабильная доступность;

- проблемы с robots.txt.

Если удаленный документ честно отдает 404 или 410, это нормальная ситуация. Хуже, когда проект подвисает, перегружается или регулярно отвечает серверными ошибками.

Количество страниц

Для бюджета обхода важно не просто число документов, а объем адресов, которые реально попадают в поле зрения поисковика. Основную нагрузку создают не ценные разделы, а лишние варианты URL.

Чаще всего ресурс рассеивается на такие группы:

- фильтры и сортировки;

- адреса с параметрами;

- результаты внутреннего поиска;

- пагинация;

- дубли карточек и категорий;

- старые URL с редиректами;

- служебные разделы.

Один фильтр сам по себе не страшен. Проблемы начинаются тогда, когда проект порождает тысячи комбинаций с почти одинаковым содержимым.

Качество внутренней перелинковки

Хорошая перелинковка помогает быстрее находить приоритетные разделы и понимать их место в структуре. Когда ключевые документы связаны логично и доступны из основных блоков навигации, их проще обнаружить и чаще переобходить.

Слабая связность дает обратный эффект. Полезные URL оказываются глубоко в структуре, выпадают из внимания и получают меньше внутренних сигналов. Карта сайта помогает, но полноценную архитектуру она не заменяет.

Как оптимизировать Crawl Budget сайта

Оптимизация начинается с чистки лишних адресов. Чем меньше на проекте дублей, служебных URL, бесконечных фильтров и мусорных параметров, тем легче поисковому боту сосредоточиться на полезных документах.

Настройка robots.txt

Файл robots.txt используют для управления обходом. Через него ограничивают доступ к тем разделам, которые не должны отнимать ресурс у поиска.

Обычно здесь проверяют:

- закрыты ли результаты внутреннего поиска;

- ограничены ли фильтры и служебные параметры;

- нет ли запрета на нужные разделы;

- указан ли путь к карте сайта.

Перекрывать все подряд нельзя. Ошибка в правилах легко отрежет от обхода полезные документы.

Оптимизация карты сайта XML

Карта сайта помогает быстрее обнаруживать приоритетные URL. В нее включают канонические адреса, которые должны индексироваться и реально участвуют в поисковом трафике.

В карте сайта не должно быть:

- дублей;

- редиректных URL;

- удаленных документов;

- служебных разделов;

- неканонических версий.

Чем чище XML-карта, тем меньше лишнего шума получает поисковик.

Удаление дублей страниц

Повторяющиеся адреса сильнее всего размывают обход. Их сокращают через канонические URL, редиректы, чистку параметров и пересмотр логики фильтров.

Особого внимания требует фасетная навигация. Если каталог создает тысячи комбинаций по цвету, размеру, цене и другим признакам, часть таких URL лучше исключить из обхода, а часть свести к основным разделам.

Здесь полезно проверить:

- дубли карточек и категорий;

- параметры в URL;

- сортировки;

- фильтровые комбинации;

- страницы без спроса и пользы.

Таблица: ошибки, которые расходуют Crawl Budget

В таблице собраны ошибки, которые чаще всего мешают нормальному обходу сайта и заставляют поискового робота тратить ресурс на лишние URL.

| Ошибка | Почему расходует бюджет обхода | Что делать |

| Фильтры и фасеты | создают много комбинаций с близким содержимым | ограничить лишние сочетания, пересмотреть логику фильтров |

| Адреса с параметрами | плодят дублирующие версии | сократить число вариантов URL, убрать лишние параметры |

| Поиск по сайту | генерирует страницы без самостоятельной ценности | закрыть такие адреса от обхода |

| Дубли карточек и категорий | бот проверяет несколько версий одного документа | свести сигналы к основным URL |

| Цепочки редиректов | часть ресурса уходит на промежуточные переходы | сократить цепочки, вести сразу на конечный адрес |

| Медленный сервер | поисковик снижает активность | ускорить отклик, устранить узкие места |

| Ошибки 5xx и 429 | появляются проблемы с доступностью | снять перегрузку и стабилизировать работу |

| Мусор в карте сайта | в обход попадают слабополезные или лишние адреса | оставить только нужные URL с кодом 200 |

| Слабая перелинковка | приоритетные разделы хуже находятся | усилить внутренние ссылки |

| «Сиротские» страницы | адреса почти не связаны с остальной структурой | встроить их в навигацию и внутренние блоки |

Инструменты для анализа обхода сайта

Оценивать бюджет обхода на глаз бессмысленно. Нужны данные: как часто поисковый бот заходит на ресурс, какие адреса запрашивает и где сталкивается с ошибками.

Google Search Console

Здесь в первую очередь смотрят статистику обхода. Отчет показывает количество запросов, объем загруженных данных, среднее время ответа и проблемы с доступностью.

Отдельно полезен отчет по индексированию. Он помогает увидеть, какие URL уже известны поисковику, но еще не попали в индекс.

Яндекс Вебмастер

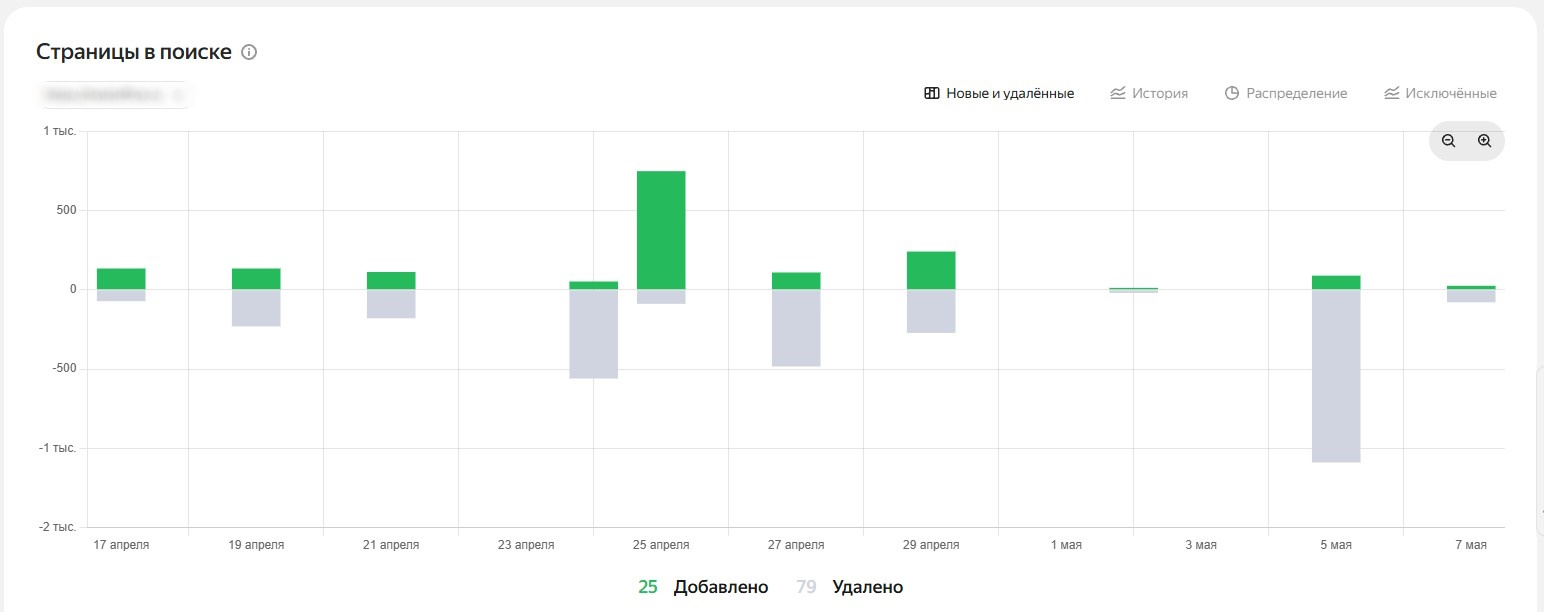

В Яндекс Вебмастере полезна статистика обхода. Она показывает посещенные страницы, ошибки загрузки и коды ответа. По этим данным удобно отслеживать эффект после технических правок.

Для крупных проектов бывает полезна и настройка скорости обхода. Она помогает аккуратнее управлять нагрузкой после изменений на сервере.

Лог-анализ сервера

Логи дают самую точную картину. По ним видно, какие адреса бот реально запрашивает, как часто возвращается в отдельные разделы и где упирается в ошибки, редиректы или медленный отклик.

Лог-анализ особенно полезен, если:

- проект очень большой;

- в индекс попадает не все нужное;

- бот часто обходит мусорные URL.

Screaming Frog и другие краулеры

Краулеры не показывают поведение поискового робота напрямую, но помогают быстро проверить структуру сайта. Через них удобно искать дубли, сиротские страницы, длинные цепочки редиректов, ошибки ответа и лишние адреса в навигации. После такой проверки проще понять, почему обход расходуется не на те разделы.

Часто задаваемые вопросы о Crawl Budget

Что такое Crawl Budget в SEO?

Это объем URL, которые поисковая система готова обойти за определенное время.

Когда Crawl Budget становится проблемой?

На крупных сайтах с фильтрами, дублями, параметрами и частыми обновлениями.

Что влияет на Crawl Budget сайта?

Скорость сервера, число URL, дубли, структура сайта и внутренняя перелинковка.

Как оптимизировать Crawl Budget?

Убрать лишние адреса, ограничить обход служебных страниц, почистить дубли, обновить карту сайта и проверить сервер.

Выводы

Crawl Budget в SEO важен там, где у сайта много адресов, частые обновления и сложная структура. Чем меньше дублей, параметров, служебных страниц и прочего технического балласта, тем легче поисковому роботу сосредоточиться на полезных URL. Если держать в порядке сервер, внутренние ссылки, карту сайта и правила обхода, важные страницы будут быстрее попадать в проверку и индекс.